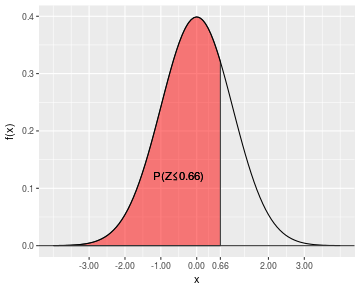

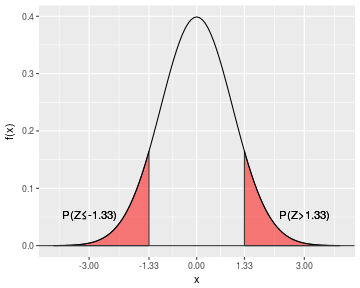

class: center, middle, inverse, title-slide # Estadística y Procesos Estocásticos <br> Tema 2: Variables Aleatorias ### <br><br><br><br><br><br><br>Grado en Ingeniería en Tecnologías de la Telecomunicación --- background-image: url(http://www.dma.ulpgc.es/profesores/personal/asp/descargas/azar.jpg) background-size: cover background-position: 15% 45% class: inverse, top, left # 7. Distribuciones de probabilidad continuas especiales --- background-image: url(http://www.dma.ulpgc.es/profesores/personal/stat/webEyPE/imagenes/darkGaussianBlur.jpg) background-size: cover class: inverse, center, middle # Distribución exponencial --- ## Distribución exponencial * Esta distribución aparece asociada a fenómenos en los que la variable que se considera es la distancia entre eventos puntuales que se presentan en un medio continuo de acuerdo con una distribución de Poisson. -- * Supongamos que `\(Y_t \approx P(\lambda t)\)` cuenta el número de paquetes que llegan a un conmutador durante un intervalo de tiempo de duración `\(t\)`. -- * Sea `\(X\)` el tiempo que falta hasta que llegue el siguiente paquete. -- * La probabilidad de que hasta el próximo paquete pase un tiempo mayor que `\(\large{t}\)` es igual a la probabilidad de que en un intervalo de longitud `\(\large{t}\)` no llegue ningún paquete: `$$P\left(X\le t\right)=1-P\left(X>t\right)=1-P\left(Y_{t}=0\right)=1-e^{-\lambda t}\frac{\lambda^{0}}{0!}=1-e^{-\lambda t}$$` -- * Si `\(\lambda\)` es el número medio de paquetes que llegan por unidad de tiempo, `\(\mu=\frac{1}{\lambda}\)` es el tiempo medio que transcurre entre paquete y paquete. --- ## Distribución exponencial La variable aleatoria `\(X\)` se dice que sigue una .red[ __distribución exponencial__] de parámetro `\(\mu\)`, y se denota como `\(X \approx exp(\mu)\)`, si su función de distribución es de la forma: .resalta[ `$$\Large{F(t)=1-e^{-\frac{1}{\mu}t}}$$` ] -- Su función de densidad es entonces: .resalta[ `$$\Large{f(t)=\frac{1}{\mu}e^{-\frac{1}{\mu}t}}$$` ] --- ### .blue[Representación gráfica de la función de densidad de la distribución exponencial para varios valores de] `\(\Large{\mu}\)` <img src="tema2-4_Distribuciones_Especiales_Continuas_files/figure-html/unnamed-chunk-1-1.png" style="display: block; margin: auto;" /> --- ### .blue[Ejemplo:] El tiempo entre llegadas de paquetes a un conmutador sigue una distribución exponencial de parámetro `\(\mu = 6\; ms\)` .blue[(1).] ¿Cuál es la probabilidad de que el próximo paquete tarde menos de 4 ms. en llegar? -- `$$X\approx exp(6)\Rightarrow P\left(X\le4\right)=F\left(4\right)=1-e^{-\frac{4}{6}} = 0.4866$$` -- .blue[(2).] ¿Cuál es la probabilidad de que el próximo paquete tarde más de 6 ms. en llegar? -- `$$P\left(X>6\right)=1-F\left(6\right)=e^{-\frac{6}{6}} = 0.3679$$` -- .blue[(3).] ¿Cuál es la probabilidad de que el próximo paquete tarde en llegar entre 2 y 5 ms? -- `$$P\left(2\le X\le5\right)=\int_{2}^{5}\frac{1}{6}e^{-\frac{1}{6}x}dx=\left[-e^{-\frac{1}{6}x}\right]_{2}^{5}=e^{-\frac{2}{6}}-e^{-\frac{5}{6}}=0.2819$$` --- ### .blue[Esperanza de la distribución exponencial] .resalta[ `$$\Large{E[X] = \mu}$$` ] <br> -- .blue[ _Demostración:_] -- `$$E\left[X\right]=\int_{0}^{\infty}xf\left(x\right)dx=\int_{0}^{\infty}x\frac{1}{\mu}e^{-\frac{1}{\mu}x}dx=$$` -- Haciendo la integral por partes: `$$=-xe^{-\frac{1}{\mu}x}+\int e^{-\frac{1}{\mu}x}dx=\left[-xe^{-\frac{1}{\mu}x}-\mu e^{-\frac{1}{\mu}x}\right]_{0}^{\infty}=\mu$$` -- ### .blue[Varianza] .resalta[ `$$\Large{Var(X)=\mu^2}$$` ] --- ### .blue[ La _falta de memoria_ de la distribución exponencial] .center[ <video src="http://www.dma.ulpgc.es/profesores/personal/stat/video/doriSinMemoria.mp4" width="480" height="270" controls preload></video> ] -- Si `\(X\approx exp(\mu)\)`: .resalta[ `$$P(X>t+s | X>s) = P(X>t)\;\; \forall s$$` ] Es decir: _"Habiendo transcurrido ya un tiempo .red[s] desde la última llegada, la probabilidad de que aún falte un tiempo .red[t] hasta la siguiente llegada es independiente del valor de .red[s]"_. Es como si `\(X\)` no recordara el valor de _s_. --- ### .blue[ La _falta de memoria_ de la distribución exponencial] <br> .resalta[ `$$P(X>t+s | X>s) = P(X>t)\;\; \forall s$$` ] <br> .blue[ _Demostración:_ ] `$$\Pr\left(X>s+t\mid X>s\right)=\frac{\Pr\left(\left\{ X>s\right\} \cap\left\{ X>s+t\right\} \right)}{\Pr\left(X>s\right)}=\frac{\Pr\left(X>s+t\right)}{\Pr\left(X>s\right)}=$$` -- `$$\Large{\frac{e^{-\frac{\left(s+t\right)}{\mu}}}{e^{-\frac{s}{\mu}}}=e^{-\frac{t}{\mu}}} = \large{\Pr\left(X>t\right)}$$` --- background-image: url(http://www.dma.ulpgc.es/profesores/personal/stat/webEyPE/imagenes/darkGaussianBlur.jpg) background-size: cover class: inverse, center, middle # Distribución de Weibull --- ## Distribución de Weibull .pull-left[  [Waloddi Weibull (1887-1979)](http://www.barringer1.com/weibull_bio.htm) ] .pull-right[ La distribución de Weibull constituye una extensión de la distribución exponencial que evita la falta de memoria de esta última. Se utiliza ampliamente en teletráfico y fiabilidad. Su función de distribución es: <br> <div class=resalta>$$\Large{F\left(t\right)=1-e^{-\left(t/\mu\right)^{\kappa}}, \;\;\;t\ge0}$$</div><br> Los parámetros `\(\mu\)` y `\(\kappa\)` reciben el nombre de parámetros de .red[ __escala__] y .red[ __forma__], respectivamente. ] -- Cuando `\(\kappa=1\)` la distribución de Weibull coincide con la exponencial de parámetro `\(\mu\)` --- ## Distribución de Weibull La función de densidad de la distribución de Weibull es: .resalta[ `$$\Large{f\left(t\right)=\frac{\kappa}{\mu}\left(\frac{t}{\mu}\right)^{\kappa-1}e^{-\left(t/\mu\right)^{k}},\,\,\,t\ge0}$$` ] --- ### .blue[Representación gráfica de la función de densidad de la distribución de Weibull para] `\(\huge{\kappa=2}\)` .blue[y varios valores de] `\(\huge{\mu}\)` <img src="tema2-4_Distribuciones_Especiales_Continuas_files/figure-html/unnamed-chunk-2-1.png" style="display: block; margin: auto;" /> --- ### .blue[Representación gráfica de la función de densidad de la distribución de Weibull para] `\(\huge{\mu=20}\)` .blue[y varios valores de] `\(\huge{\kappa}\)` <img src="tema2-4_Distribuciones_Especiales_Continuas_files/figure-html/unnamed-chunk-3-1.png" style="display: block; margin: auto;" /> --- ## Distribución de Weibull ### .blue[Esperanza y Varianza] .resalta[ `$$\Large{E[X]= \mu\Gamma\left(1+\frac{1}{\kappa}\right)}$$` ] .resalta[ `$$\Large{Var(X)= \mu^2\left[\Gamma\left(1+\frac{2}{\kappa}\right)-\Gamma\left(1+\frac{1}{\kappa}\right)^2\right]}$$` ] siendo `\(\Gamma\)` la .red[función gamma de Euler]: `\(\Gamma\left(x\right)=\int_{0}^{\infty}t^{x-1}e^{-t}dt\)`. Si `\(n\)` es un número entero `\(\Gamma(n)=(n-1)!\)`; si `\(x\)` es real, `\(\Gamma(x)\)` debe aproximarse numéricamente. En octave se calcula mediante .red[gamma(x)] --- ### .blue[Ejemplo:] Sea `\(X\)`= _tiempo entre llegadas de paquetes a un conmutador_ `\(\approx W(\kappa=2,\mu=20)\)` .blue[(1).] ¿Cuál es la probabilidad de que el próximo paquete llegue en menos de 16 ms? -- `$$P\left(X\le16\right)=F\left(16\right)=1-e^{-\left(16/20\right)^{2}}=0.473$$` -- .blue[(2).] ¿Cuál es la probabilidad de que el próximo paquete tarde más de 10 ms.? -- `$$P\left(X>10\right)=1-P\left(X\le10\right)=1-F\left(10\right)=e^{-\left(10/20\right)^{2}}=0.7788$$` -- .blue[(3).] ¿Cuál es la probabilidad de que el próximo paquete tarde en llegar entre 15 y 30 ms? -- `$$P\left(15\le X\le30\right)=\int_{15}^{30}f(x)dx=F(30)-F(15)=0.4644$$` -- .blue[(4).] ¿Cuál es el tiempo medio que transcurre entre la llegada de dos paquetes consecutivos? -- `$$E[X]= 20\Gamma\left(1+\frac{1}{2}\right)=20\cdot 0.8862=17.7245\; ms.$$` --- background-image: url(http://www.dma.ulpgc.es/profesores/personal/stat/webEyPE/imagenes/darkGaussianBlur.jpg) background-size: cover class: inverse, center, middle # Distribución uniforme --- ## Distribución uniforme `\(\;\;\Large{U[a,b]}\)` Esta es la distribución de la variable: `\(\Large{X}\)` = _"Resultado de elegir un valor al azar en el intervalo_ `\(\large{[a,b]}\)`" cuando la probabilidad se reparte de manera homogénea (uniforme) sobre el intervalo, esto es, no hay más probabilidad de observar valores en una zona que en otra del mismo. .pull-left[ Su función de densidad es de la forma: .resalta[ `$$\Large{f(x)=\frac{1}{b-a}\;\;\; a\le x\le b}$$` ] ] .pull.right[ <img src="tema2-4_Distribuciones_Especiales_Continuas_files/figure-html/unnamed-chunk-4-1.png" style="display: block; margin: auto;" /> ] -- Ya hemos visto esta distribución en el ejemplo del lugar (aleatorio) donde se avería un coche en una carretera larga y recta. --- ### Distribución uniforme: Función de distribución .resalta[ `$$\large{F(x)=P\left(X\le x\right)=\frac{x-a}{b-a}\,\,\,\,x\in\left(a,b\right)}$$` ] -- ### Distribución uniforme: Esperanza y varianza Es fácil comprobar que: .resalta[ `$$\large{E[X]=\frac{a+b}{2}}$$` <br> `$$\large{Var(X)=\frac{(b-a)^2}{12}}$$` ] --- background-image: url(http://www.dma.ulpgc.es/profesores/personal/stat/webEyPE/imagenes/darkGaussianBlur.jpg) background-size: cover class: inverse, center, middle # Distribución Normal o de Gauss --- ## Distribución Normal o de Gauss .pull-left[  [Carl Friedrich Gauss (1777-1855)](https://en.wikipedia.org/wiki/Carl_Friedrich_Gauss) ] -- .pull-right[ La distribución normal aparece asociada a variables aleatorias que se comportan de tal manera que lo más probable es observar valores en torno a la media; y a medida que los valores se alejan de la media, bien sea hacia arriba o hacia abajo, van siendo progresivamente más difíciles de observar: <img src="tema2-4_Distribuciones_Especiales_Continuas_files/figure-html/unnamed-chunk-5-1.png" style="display: block; margin: auto;" /> ] --- ## Distribución Normal o de Gauss Múltiples ejemplos de variables con esta distribución: -- * Errores de Medida. -- * Magnitud del ruido superpuesto a una señal. -- * Temperatura de un microcircuito en condiciones normales de operación. -- * Variables Biológicas: peso, talla, nivel de glucosa en sangre ... -- * Consumo de energía diario en una ciudad o en una empresa. -- * Kilometraje mensual recorrido por un vehículo arbitrario. -- * ... -- ¿Por qué es tan ubicua la distribución normal? .center[Acción del .red[teorema central del límite]] --- ## Teorema central del límite .center[ <iframe width="560" height="315" src="https://www.youtube.com/embed/VQepRP-f6GA" frameborder="0" allow="encrypted-media" allowfullscreen></iframe> ] -- De forma intuitiva, el teorema central del límite afirma que dado un conjunto de variables aleatorias independientes, con cualquier distribución de probabilidad y suponiendo que su varianza sea finita, la suma de un número elevado de estas variables tiende a distribuirse de manera similar a una variable normal. --- ## Distribución Normal o de Gauss Una variable aleatoria `\(X\)` sigue una distribución Normal de parámetros `\(\mu\)` (esperanza) y `\(\sigma\)` (desviación típica) y se denota como `\(X \approx N(\mu,\sigma)\)`, si su función de densidad de probabilidad es de la forma: .resalta[ `$$\Large{f\left(x\right)=\frac{1}{\sigma\sqrt{2\pi}}e^{-\frac{1}{2}\left(\frac{x-\mu}{\sigma}\right)^{2}},\,\,x\in\mathbb{R}}$$` ] -- <br> Puede comprobarse que: `$$E\left[X\right]=\int_{-\infty}^{\infty}xf\left(x\right)dx=\mu$$` `$$Var\left[X\right]=\int_{-\infty}^{\infty}\left(x-\mu\right)^{2}f\left(x\right)dx=\sigma$$` --- ### .blue[Representación gráfica de la función de densidad de la distribución normal para varios valores de] `\(\Large{\mu}\)` .blue[y] `\(\Large{\sigma}\)` <img src="tema2-4_Distribuciones_Especiales_Continuas_files/figure-html/unnamed-chunk-6-1.png" style="display: block; margin: auto;" /> --- ## Distribución normal: cálculo de probabilidades. * La función de densidad de la distribución normal no puede integrarse de manera analítica, sino numérica. De ahí que para calcular probabilidades de la forma `\(P(X\le x)\)` o `\(P(a\le X \le b)\)` haya que recurrir a calculadora, ordenador o tablas de referencia. -- * El siguiente resultado permite convertir una variable `\(N(\mu,\sigma)\)` en una `\(N(0,1)\)`; de esta forma las probabilidades de la primera pueden calcularse a partir de las probabilidades de la segunda: -- .resalta[ __Teorema (de la tipificación):__ _Si una variable aleatoria X tiene distribución de probabilidad `\(N\left({\mu,\sigma}\right)\)`, entonces, `\(Z=\frac{\left(X-\mu\right)}{\sigma}\)` tiene distribución de probabilidad `\(N\left({0,1}\right)\)` (normal estándar o tipificada). Por tanto:_ `$$\Large{P\left(X\le x\right)=P\left(\frac{X-\mu}{\sigma}\le\frac{x-\mu}{\sigma}\right)=P\left(Z\le\frac{x-\mu}{\sigma}\right)}$$` ] ---  --- ## Distribución normal: uso de la tabla de la _N(0,1)_ * Esta tabla nos permite calcular probabilidades de la forma `\(P\left(Z>x\right)\)` donde `\(Z\)` es una variable aleatoria con distribución `\(N\left(0,1\right)\)` y `\(x\)` es un número de la forma `\(a.bc = a.b+0.0c\)`. El valor de dicha probabilidad se encuentra en el cruce de la fila `\(a.b\)` con la columna `\(0.0c\)`. -- * .blue[Ejemplo:] para calcular `\(P\left(Z>1.23\right)\)` se busca en el cruce de la fila `\(1.2\)` con la columa `\(0.03\)`, donde se encuentra el valor `\(0.10935\)`. -- * En el caso de que se desee calcular la probabilidad de que Z sea mayor que un número negativo, se puede proceder aprovechando la circunstancia de que la función de densidad de Z es simétrica y por tanto: `$$P\left(Z>-x\right)=P\left(Z<x\right)= 1-P(Z>x)$$` -- * Para calcular la probabilidad de un intervalo: `$$P(a\le Z \le b)=P(Z>a)-P(Z>b)$$` --- ## Distribución normal: uso de la tabla de la _N(0,1)_ * Sea `\(X\approx N(\mu=8,\sigma=3)\)`: .pull-left[ <br><br> `$$P\left(X\le10\right)=P\left(Z\le\frac{10-8}{3}\right)=$$` `$$=P\left(Z\le0.66\right)=1-P\left(Z>0.66\right)$$` `$$=1-0.25463=0.74537$$` ] .pull-right[ <!-- --> ] --- ## Distribución normal: uso de la tabla de la _N(0,1)_ * Sea `\(X\approx N(\mu=8,\sigma=3)\)`: .pull-left[ <br><br> `$$P\left(X\le4\right)=P\left(Z\le\frac{4-8}{3}\right)=$$` `$$=P\left(Z\le-1.33\right)=P\left(Z>1.33\right)=0.09176$$` ] .pull-right[ <!-- --> ]